写在前面

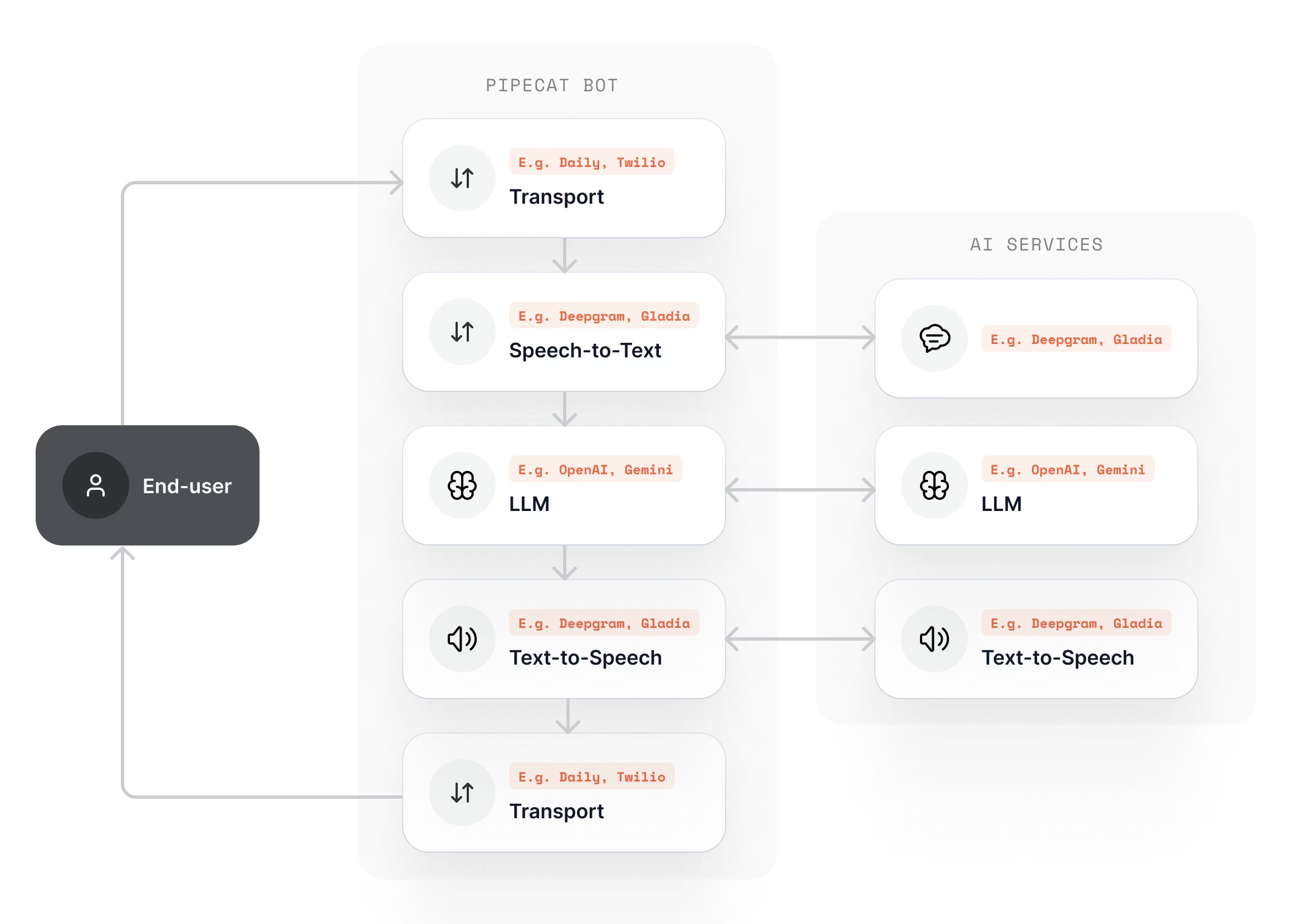

最近需要实现一个 AI 语音聊天功能。对比了一圈当前常见的语音 Agent 方案之后,我决定深入阅读 Pipecat 的源码,这篇笔记就是整个阅读过程的整理稿。

可以了解Pipecat 如何组织实时语音 pipeline、如何把 turn detection 与上下文提交衔接起来,以及 function calling / interruption / termination 这些“运行时状态变化”如何被统一收束到 frame 流里。

Pipecat 官网:pipecat.ai

Pipecat 仓库:pipecat-ai/pipecat

一、Pipeline Architecture:数据如何在 Pipecat 中流动

1.1 Frame: The Universal Data Unit

Source: src/pipecat/frames/frames.py

Pipecat 中的一切都是 Frame。Frame 是一个简单的 @dataclass,包含一个自动生成的 id、一个可读的 name,以及可选的 metadata。

# frames.py:116-154

@dataclass

class Frame:

id: int = field(init=False) # globally unique

name: str = field(init=False) # e.g. "TextFrame#42"

pts: Optional[int] = field(init=False) # presentation timestamp (nanoseconds)

metadata: Dict[str, Any] = field(init=False)

Frames are organized into a three-tier priority hierarchy:

| Base Class | Priority | Interruptible? | Examples |

|---|---|---|---|

SystemFrame | HIGH — always processed first | No | StartFrame, CancelFrame, InterruptionFrame |

DataFrame | Normal — queued in order | Yes — cleared on interruption | AudioRawFrame, TextFrame, ImageRawFrame |

ControlFrame | Normal — queued in order | Yes — cleared on interruption | EndFrame, StopFrame |

设计原则:Frame 的继承层级直接编码了调度策略。 不同于使用标志位或配置项,Frame 的类型本身直接决定了它如何排队、以及是否在中断时被保留。这是经典的类型驱动设计 (Type-Driven Design) —— 类型系统承载了运行时会自动强制执行的语义意义。

UninterruptibleFrame 混入类 (mixin) 用于标记那些即使是 DataFrame 或 ControlFrame 也必须在中断中存活下来的帧:

# frames.py:198-207

@dataclass

class UninterruptibleFrame:

"""A marker for data or control frames that must not be interrupted."""

pass

1.2 FrameProcessor: The Processing Unit

Source: src/pipecat/processors/frame_processor.py

管道中的每个处理器都继承自 FrameProcessor。这是核心的抽象 —— 它定义了帧如何进入、如何被处理、以及如何离开。

The Dual-Queue Architecture

每个 FrameProcessor 拥有两个内部队列,由两个独立的异步任务管理:

┌──────────────────────────────────────────────┐

│ FrameProcessor │

│ │

frame arrives → │ __input_queue (PriorityQueue) │

via queue_frame() │ │ │

│ ├─ SystemFrame? → process immediately │

│ │ (in input task) │

│ └─ Other frame? → put in __process_queue │

│ │

│ __process_queue (asyncio.Queue) │

│ └─ process in FIFO order │

│ (in process task) │

└──────────────────────────────────────────────┘

Key code — the priority queue (frame_processor.py:85-133):

class FrameProcessorQueue(asyncio.PriorityQueue):

HIGH_PRIORITY = 1

LOW_PRIORITY = 2

async def put(self, item):

frame, _, _ = item

if isinstance(frame, SystemFrame):

await super().put((self.HIGH_PRIORITY, self.__high_counter, item))

else:

await super().put((self.LOW_PRIORITY, self.__low_counter, item))

设计原则:通过队列分离来防止优先级反转。

SystemFrames(比如 InterruptionFrame)不会被阻塞在长长的音频帧队列后面。PriorityQueue 保证了它们能被优先取出,而处理任务的分离(__input_frame_task_handler 和 __process_frame_task_handler)则意味着系统帧在一个完全独立的执行路径上被处理。

Key code — the input task (frame_processor.py:1036-1062):

async def __input_frame_task_handler(self):

while True:

(frame, direction, callback) = await self.__input_queue.get()

if isinstance(frame, SystemFrame):

await self.__process_frame(frame, direction, callback) # immediate

else:

await self.__process_queue.put((frame, direction, callback)) # deferred

Direct Mode

Pipeline 容器类(Pipeline, PipelineSource, PipelineSink)会设置 enable_direct_mode=True,这会完全绕过这两个内部队列:

# frame_processor.py:612-632

async def queue_frame(self, frame, direction, callback=None):

if self._enable_direct_mode:

await self.__process_frame(frame, direction, callback) # no queue

else:

await self.__input_queue.put((frame, direction, callback))

设计原则:避免不必要的间接开销。

Pipeline 容器纯粹是路由节点 —— 它们不转换数据,只负责转发帧。为每一个通过 Pipeline 包装器的帧增加队列进出的开销是很浪费的。Direct mode(直通模式)消除了这种开销。

Linking: The Doubly-Linked List

处理器之间通过 _prev 和 _next 指针形成了一个双向链表:

# frame_processor.py:581-589

def link(self, processor: "FrameProcessor"):

self._next = processor

processor._prev = self

推送帧 (Pushing frames) 会根据方向路由到相邻的处理器:

# frame_processor.py:909-944

async def __internal_push_frame(self, frame, direction):

if direction == FrameDirection.DOWNSTREAM and self._next:

await self._next.queue_frame(frame, direction)

elif direction == FrameDirection.UPSTREAM and self._prev:

await self._prev.queue_frame(frame, direction)

设计原则:双向数据流实现了错误传递的解耦。

错误(ErrorFrame)可以向上游流动,而不需要处理器了解任何关于管道拓扑的信息。每个处理器只需简单地把帧向上一级推送,帧自然就会到达任务的源处理器(source handler)。

1.3 Pipeline: The Chain

Source: src/pipecat/pipeline/pipeline.py

Pipeline 将各个处理器按顺序连接起来,并在两端分别包装上 PipelineSource 和 PipelineSink:

# pipeline.py:99-121

class Pipeline(BasePipeline):

def __init__(self, processors, source=None, sink=None):

self._source = source or PipelineSource(self.push_frame)

self._sink = sink or PipelineSink(self.push_frame)

self._processors = [self._source] + processors + [self._sink]

self._link_processors()

def _link_processors(self):

prev = self._processors[0]

for curr in self._processors[1:]:

prev.link(curr)

prev = curr

结果形成如下的链表结构:

Source ←→ Processor1 ←→ Processor2 ←→ ... ←→ ProcessorN ←→ Sink

Nested Pipeline Support

由于 Pipeline 本身也是一个 FrameProcessor,因此管道可以相互嵌套。当一个帧到达嵌套管道时,会被路由到子管道的 source 节点中:

# pipeline.py:183-195

async def process_frame(self, frame, direction):

if direction == FrameDirection.DOWNSTREAM:

await self._source.queue_frame(frame, FrameDirection.DOWNSTREAM)

elif direction == FrameDirection.UPSTREAM:

await self._sink.queue_frame(frame, FrameDirection.UPSTREAM)

PipelineSource 和 PipelineSink 负责处理跨越边界的情况 —— 从子管道流出的帧会被通过回调(self.push_frame)转发给父管道:

# pipeline.py:21-52 (PipelineSource)

async def process_frame(self, frame, direction):

match direction:

case FrameDirection.UPSTREAM:

await self._upstream_push_frame(frame, direction) # escape to parent

case FrameDirection.DOWNSTREAM:

await self.push_frame(frame, direction) # continue in sub-pipeline

设计原则:通过组合模式 (Composite Pattern) 实现统一接口。

Pipeline 本身也就是一个 FrameProcessor。这意味着任何可以接收处理器的地方,同样可以接收一个管道。你可以随意嵌套:Pipeline([Pipeline([A, B]), C, Pipeline([D, E])])。这种双向链表结构对内部的处理器是完全透明的。

1.4 Interruption Handling

当 InterruptionFrame (一种 SystemFrame) 到达处理器时:

# frame_processor.py:892-907

async def _start_interruption(self):

if isinstance(self.__process_current_frame, UninterruptibleFrame):

self.__reset_process_queue() # drain queue, keep current frame

else:

await self.__cancel_process_task() # cancel current processing

self.__create_process_task() # start fresh

重置队列时会保留 UninterruptibleFrame 的实例:

# frame_processor.py:995-1012

def __reset_process_queue(self):

new_queue = asyncio.Queue()

while not self.__process_queue.empty():

item = self.__process_queue.get_nowait()

if isinstance(item[0], UninterruptibleFrame):

new_queue.put_nowait(item)

# swap queues...

设计原则:中断是取消并重启,而不是检查标志位。

框架不是在处理逻辑中到处穿插对"是否已取消"标志位的检查,而是直接取消整个异步任务并创建一个全新的任务。这在无需各个处理器配合检查的情况下,保证了状态的干净。UninterruptibleFrame 为那些无论如何都必须执行完的帧提供了一个逃生通道。

二、PipelineTask:任务编排器

Source: src/pipecat/pipeline/task.py

PipelineTask 会将用户的管道包装在另一个内部带有可控 Source 和 Sink 的独立 Pipeline 中:

# task.py:391-397

source = PipelineSource(self._source_push_frame)

self._sink = PipelineSink(self._sink_push_frame)

processors = [pipeline] # user's pipeline

self._pipeline = Pipeline(processors, source=source, sink=self._sink)

完整的调用链:

Task::Source → [UserPipeline::Source → P1 → P2 → ... → UserPipeline::Sink] → Task::Sink

↑ │

└──────────── upstream frames (errors, task control) ──────────────────────┘

2.1 The Startup Sequence

# task.py:823-864

async def _process_push_queue(self):

self._clock.start()

# Step 1: Create and push StartFrame through the entire pipeline

start_frame = StartFrame(

allow_interruptions=...,

audio_in_sample_rate=...,

enable_metrics=...,

...

)

await self._pipeline.queue_frame(start_frame)

# Step 2: Wait for StartFrame to traverse all processors

await self._wait_for_pipeline_start(start_frame)

# Step 3: Main loop — pull user-queued frames and feed them

while running:

frame = await self._push_queue.get()

await self._pipeline.queue_frame(frame)

if isinstance(frame, (CancelFrame, EndFrame, StopFrame)):

await self._wait_for_pipeline_end(frame)

running = not isinstance(frame, (CancelFrame, EndFrame, StopFrame))

设计原则:StartFrame 作为初始化广播。

与其设计一套单独的初始化协议,不如让 StartFrame 携带所有的配置信息(采样率、指标开关、中断策略等),并通过常规的帧机制流经每一个处理器。每个处理器在它的 process_frame() 方法中,从 StartFrame 里按需读取配置。这确保了所有处理器按顺序完成初始化,并且在任何数据开始流动前,管道已完全就绪。

2.2 Boundary Handlers

任务 Source 端 (Task Source) (task.py:866-903) — 捕获从管道内向上游流出的帧:

async def _source_push_frame(self, frame, direction):

if isinstance(frame, EndTaskFrame):

await self.queue_frame(EndFrame()) # graceful stop

elif isinstance(frame, CancelTaskFrame):

await self.queue_frame(CancelFrame()) # immediate cancel

elif isinstance(frame, ErrorFrame):

if frame.fatal:

await self.queue_frame(CancelFrame()) # fatal → cancel everything

任务 Sink 端 (Task Sink) (task.py:905-936) — 捕获从管道内向下游流出的帧:

async def _sink_push_frame(self, frame, direction):

if isinstance(frame, StartFrame):

self._pipeline_start_event.set() # signal: pipeline is ready

elif isinstance(frame, EndFrame):

self._pipeline_end_event.set() # signal: pipeline is done

elif isinstance(frame, HeartbeatFrame):

await self._heartbeat_queue.put(frame)

设计原则:任务级别的帧 (EndTaskFrame, CancelTaskFrame) 在边界处被转换为管道级别的帧 (EndFrame, CancelFrame)。

这种关注点分离,使得处于管道内部的处理器能够发出"请停止"的信号,而不需要了解外层的 Task 是如何管理生命周期的。Task 层充当了"意图"和"机制"之间的翻译器。

2.3 Lifecycle Events

PipelineTask 提供了一套丰富的事件系统:

@task.event_handler("on_pipeline_started")

async def on_pipeline_started(task, frame):

# Pipeline is ready, StartFrame has traversed all processors

...

@task.event_handler("on_pipeline_finished")

async def on_pipeline_finished(task, frame):

# Pipeline has terminated (EndFrame, StopFrame, or CancelFrame)

...

@task.event_handler("on_pipeline_error")

async def on_pipeline_error(task, frame):

# An ErrorFrame reached the source

...

@task.event_handler("on_idle_timeout")

async def on_idle_timeout(task):

# No activity for idle_timeout_secs

...

2.4 PipelineRunner: The Entry Point

Source: src/pipecat/pipeline/runner.py

最简单的一层封装 — 它只是用信号处理将其包裹在 task.run() 之外:

# runner.py:65-95

class PipelineRunner:

async def run(self, task: PipelineTask):

try:

params = PipelineTaskParams(loop=self._loop)

await task.run(params)

except asyncio.CancelledError:

pass

它配置了 SIGINT/SIGTERM 信号处理器,通过调用 task.cancel() 实现优雅停机。

三、Development Runner:开发期启动基础设施

Source: src/pipecat/runner/run.py

在开发阶段使用的 runner (pipecat.runner.run) 是与管道 runner 完全独立的基础设施。它提供了 bot 接受连接所需的 HTTP/WebSocket/WebRTC 环境。

3.1 Architecture Overview

┌─────────────────────────────────────┐

main() ────────→ │ FastAPI Server (uvicorn) │

│ │

CLI args: │ Transport-specific routes: │

-t webrtc │ /api/offer (WebRTC SDP) │

-t daily │ /start (Daily room) │

-t twilio │ /ws (WebSocket) │

│ / (redirect/status) │

│ │

│ On connection: │

│ 1. Create RunnerArguments │

│ 2. Call bot_module.bot(args) │

└─────────────────────────────────────┘

3.2 Bot Discovery

Runner 启动时会自动去发现用户的 bot() 函数:

# run.py:114-153

def _get_bot_module():

# 1. Check __main__ module (the file that was executed)

main_module = sys.modules["__main__"]

if hasattr(main_module, "bot"):

return main_module

# 2. Try importing 'bot' module from current directory

# 3. Scan .py files in current directory for a 'bot' function

设计原则:约定优于配置 (Convention over configuration)。

Runner 使用了一个简单的约定 —— 你的 bot 文件必须导出一个 async def bot(runner_args) 函数。没有注册表,没有装饰器,也没有配置文件。这和 pytest 测试发现 (test discovery) 遵循的是相同的原则。

3.3 Transport-Specific Argument Types

Source: src/pipecat/runner/types.py

@dataclass

class RunnerArguments: # Base: body, cli_args

class DailyRunnerArguments(RunnerArguments): # + room_url, token

class WebSocketRunnerArguments(RunnerArguments): # + websocket

class SmallWebRTCRunnerArguments(RunnerArguments): # + webrtc_connection

bot 函数利用 isinstance() 检测实际配置在使用的是哪种 transport:

async def bot(runner_args: RunnerArguments):

if isinstance(runner_args, DailyRunnerArguments):

transport = DailyTransport(runner_args.room_url, runner_args.token, ...)

elif isinstance(runner_args, SmallWebRTCRunnerArguments):

transport = SmallWebRTCTransport(runner_args.webrtc_connection, ...)

设计原则:通过类型层级实现多态,而不是强依赖字符串类型的配置字典。

每种 Transport 都有它自己的参数类型,包含了它所需要的特定字段。bot 函数只需使用类型安全的 isinstance() 检查,而不必去解析一个带有各种底层传输特定 key 的字典。

3.4 The proxy_request Endpoint

Source: run.py:302-340

该端点模拟了 Pipecat Cloud 的会话代理,为所有的 WebRTC 客户端提供统一的 API 接口:

@app.api_route(

"/sessions/{session_id}/{path:path}",

methods=["GET", "POST", "PUT", "PATCH", "DELETE"],

)

async def proxy_request(session_id, path, request, background_tasks):

# 1. Validate session exists

active_session = active_sessions.get(session_id)

if active_session is None:

return Response(content="Invalid or not-yet-ready session_id", status_code=404)

# 2. Route WebRTC signaling to the offer/ice handlers

if path.endswith("api/offer"):

if request.method == "POST":

# Parse SDP offer, delegate to offer() handler

webrtc_request = SmallWebRTCRequest(sdp=..., type=..., ...)

return await offer(webrtc_request, background_tasks)

elif request.method == "PATCH":

# Parse ICE candidate, delegate to ice_candidate() handler

return await ice_candidate(patch_request)

# 3. Other paths: just acknowledge

return Response(status_code=200)

数据流程:/start 创建 session → 客户端向 /sessions/{id}/api/offer 发起 WebRTC 信令 → proxy_request 进行转化并委派给真正的 WebRTC handler处理。

设计原则:本地开发环境直接镜像生产环境的 API。

通过模拟 Pipecat Cloud 的 /start 和 /sessions/{id}/... 接口层,在本地开发的 bot 可以零修改地直接部署到生产环境并获得一致的表现。代理模式在这里充当了云端 API 和本地 WebRTC 处理程序之间的适配器。

了解了解

3.5 Session Lifecycle

Client Server

│ │

│ POST /start │

│ { enableDefaultIceServers } │

│ ─────────────────────────────→ │ Creates session_id, stores in active_sessions

│ ←───────────────────────────── │ { sessionId, iceConfig }

│ │

│ POST /sessions/{id}/api/offer │

│ { sdp, type } │

│ ─────────────────────────────→ │ proxy_request → offer()

│ │ → SmallWebRTCRequestHandler

│ │ → Creates SmallWebRTCConnection

│ │ → Spawns bot(runner_args) in background

│ ←───────────────────────────── │ { sdp answer }

│ │

│ PATCH /sessions/{id}/api/offer│

│ { candidates } │

│ ─────────────────────────────→ │ proxy_request → ice_candidate()

│ ←───────────────────────────── │ { status: success }

│ │

│ ══════ WebRTC media flow ═════│ Bot pipeline running...

四、Observer System:AOP 风格的横切观察

Pipecat 的 Observer 系统用观察者模式实现了类似 Spring AOP 的切面拦截能力,将性能打点、延迟测量、会话追踪等横切关注点与业务逻辑彻底解耦。

4.1 两个固定拦截点 — 类比 AOP 的 @Before 和 @AfterReturning

所有 Observer 的数据来源只有 FrameProcessor 基类中的两个拦截点,硬编码在每个 Frame 的生命周期里:

拦截点 1: process_frame() 入口 — “帧到达处理器”

# frame_processor.py:660-675

async def process_frame(self, frame: Frame, direction: FrameDirection):

if self._observer:

timestamp = self._clock.get_time() if self._clock else 0

data = FrameProcessed(

processor=self, # 谁在处理

frame=frame, # 处理什么帧

direction=direction, # 哪个方向

timestamp=timestamp, # 精确时间戳

)

await self._observer.on_process_frame(data)

# ... 然后才执行真正的处理逻辑

这相当于 Spring AOP 的 @Before — 在业务逻辑执行之前通知 Observer。

拦截点 2: __internal_push_frame() 出口 — “帧离开处理器”

# frame_processor.py:910-942

async def __internal_push_frame(self, frame, direction):

timestamp = self._clock.get_time() if self._clock else 0

if direction == FrameDirection.DOWNSTREAM and self._next:

if self._observer:

data = FramePushed(

source=self, # 谁推送的

destination=self._next, # 推给谁

frame=frame,

direction=direction,

timestamp=timestamp,

)

await self._observer.on_push_frame(data)

await self._next.queue_frame(frame, direction)

elif direction == FrameDirection.UPSTREAM and self._prev:

if self._observer:

data = FramePushed(

source=self,

destination=self._prev,

frame=frame,

direction=direction,

timestamp=timestamp,

)

await self._observer.on_push_frame(data)

await self._prev.queue_frame(frame, direction)

这相当于 @AfterReturning — 在处理器完成处理并推送帧时通知 Observer。

为什么只需要两个拦截点? 通过时间差计算就能得到任何处理器的处理耗时:

处理器耗时 = on_push_frame(timestamp) - on_process_frame(timestamp)

这是 StartupTimingObserver 测量每个处理器 start() 耗时的核心原理。

4.2 Observer 接口 — 极简的三方法协议

# base_observer.py

class BaseObserver(BaseObject):

async def on_process_frame(self, data: FrameProcessed):

"""帧到达处理器时调用"""

pass

async def on_push_frame(self, data: FramePushed):

"""帧从处理器推出时调用"""

pass

async def on_pipeline_started(self):

"""StartFrame 遍历完所有处理器后调用"""

pass

两个数据载体:

| 数据类 | 字段 | 含义 |

|---|---|---|

FrameProcessed | processor, frame, direction, timestamp | 谁在处理什么帧 |

FramePushed | source, destination, frame, direction, timestamp | 帧从谁流向谁 |

Observer 只能看,不能改 — 没有返回值,没有取消机制。这保证了 Observer 永远不会影响管道行为。

4.3 TaskObserver 代理 — 异步队列隔离

如果 Observer 直接在 process_frame() / __internal_push_frame() 中执行,一个慢的 Observer 会阻塞整个管道。Pipecat 用 TaskObserver 代理模式解决了这个问题:

┌─────────────────────────────────────┐

│ TaskObserver (代理) │

FrameProcessor ───→│ │

on_push_frame() │ ┌──Queue──→ Task ──→ Observer A │

│ ├──Queue──→ Task ──→ Observer B │

│ └──Queue──→ Task ──→ Observer C │

└─────────────────────────────────────┘

关键实现:

# task_observer.py

class TaskObserver(BaseObserver):

def _create_proxy(self, observer):

queue = asyncio.Queue() # 每个 Observer 独立队列

task = self._task_manager.create_task(

self._proxy_task_handler(queue, observer), # 独立消费协程

f"TaskObserver::{observer}::_proxy_task_handler",

)

return Proxy(queue=queue, task=task, observer=observer)

async def _send_to_proxy(self, data):

for proxy in self._proxies.values():

await proxy.queue.put(data) # 非阻塞地分发到所有队列

async def _proxy_task_handler(self, queue, observer):

while True:

data = await queue.get()

if isinstance(data, _PipelineStartedSignal):

await observer.on_pipeline_started()

elif isinstance(data, FramePushed):

await observer.on_push_frame(data)

elif isinstance(data, FrameProcessed):

await observer.on_process_frame(data)

queue.task_done()

这带来三个关键好处:

- 管道零阻塞:

_send_to_proxy()只做queue.put(),几乎零耗时 - Observer 间互相隔离:Observer A 卡住不影响 Observer B

- 动态增删:运行时可以

add_observer()/remove_observer()

4.4 Observer 注册流程 — 从用户代码到每个处理器

用户代码 PipelineTask FrameProcessor

│ │ │

│ PipelineTask(pipeline, │ │

│ observers=[obs_a, obs_b]) │ │

│ ─────────────────────────→ │ │

│ │ 1. 创建 TaskObserver( │

│ │ observers=[obs_a,obs_b])│

│ │ │

│ │ 2. FrameProcessorSetup( │

│ │ observer=task_observer) │

│ │ ──────────────────────────→ │

│ │ │ 3. self._observer = setup.observer

│ │ │ (所有处理器共享同一个 TaskObserver)

│ │ │

│ │ 4. task_observer.start() │

│ │ → 为每个 observer 创建 │

│ │ 独立的 Queue + Task │

# task.py:799-804 — Observer 注入到管道的每个处理器

setup = FrameProcessorSetup(

clock=self._clock,

task_manager=self._task_manager,

observer=self._observer, # TaskObserver 实例

)

await self._pipeline.setup(setup) # 递归传播到所有处理器

# task.py:402 — TaskObserver 创建

self._observer = TaskObserver(observers=observers, task_manager=self._task_manager)

4.5 三个内置 Observer 实例详解

4.5.1 StartupTimingObserver — 启动耗时度量

源码: src/pipecat/observers/startup_timing_observer.py

解决的问题: 管道里有十几个处理器(STT、LLM、TTS、Transport),哪个的 start() 最慢?如果不测量,启动慢了只能盲猜。

核心思路:利用 AOP 两个拦截点的时间差

StartFrame 会从管道头部流到尾部,每经过一个处理器都会触发 process_frame()(进入)和 push_frame()(离开)。两个时间戳之差就是该处理器 start() 的精确耗时。

状态与数据结构

# startup_timing_observer.py:53-59

@dataclass

class _ArrivalInfo:

"""内部记录:StartFrame 到达某处理器的时间"""

processor: FrameProcessor

arrival_ts_ns: int # 纳秒级时间戳

# 核心状态

self._arrivals: Dict[int, _ArrivalInfo] = {} # processor.id → 到达信息

self._timings: List[ProcessorStartupTiming] = [] # 按管道顺序收集的耗时

self._start_frame_id: Optional[str] = None # 锁定第一个 StartFrame(防重复)

self._start_frame_arrival_ns: Optional[int] = None # 全局起始时间(算 offset 用)

拦截点 1: on_process_frame — 记录"到达"

# startup_timing_observer.py:224-247

async def on_process_frame(self, data: FrameProcessed):

if self._startup_timing_reported:

return # 报告已发,不再追踪

if not isinstance(data.frame, StartFrame):

return # 只关心 StartFrame

# 锁定第一个 StartFrame(ParallelPipeline 中可能有多个 StartFrame 副本)

if self._start_frame_id is None:

self._start_frame_id = data.frame.id

self._start_frame_arrival_ns = data.timestamp # 全局起点

self._start_wall_clock = time.time()

elif data.frame.id != self._start_frame_id:

return # 忽略其他 StartFrame

if self._should_track(data.processor):

self._arrivals[data.processor.id] = _ArrivalInfo(

processor=data.processor,

arrival_ts_ns=data.timestamp, # 记录到达时间

)

关键设计:_start_frame_id 锁定机制。 ParallelPipeline 会复制 StartFrame 发给每条并行分支。如果不锁定 frame ID,不同分支的 StartFrame 副本会互相干扰。

_should_track() 过滤器:

# startup_timing_observer.py:200-212

_INTERNAL_TYPES = (PipelineSource, BasePipeline) # 内部管道组件

def _should_track(self, processor):

if self._processor_types is not None:

return isinstance(processor, self._processor_types) # 用户指定类型

return not isinstance(processor, _INTERNAL_TYPES) # 默认排除内部组件

默认过滤掉 PipelineSource、BasePipeline 等纯路由节点,因为它们的 start() 几乎为零,加入报告只会增加噪音。

拦截点 2: on_push_frame — 计算"耗时"

# startup_timing_observer.py:249-289

async def on_push_frame(self, data: FramePushed):

# ---- 传输层建连度量(与启动度量独立)----

if isinstance(data.frame, BotConnectedFrame):

self._handle_bot_connected(data)

return

if isinstance(data.frame, ClientConnectedFrame):

await self._handle_client_connected(data)

return

# ---- StartFrame 度量 ----

if self._startup_timing_reported:

return

if not isinstance(data.frame, StartFrame):

return

if self._start_frame_id is not None and data.frame.id != self._start_frame_id:

return

arrival = self._arrivals.pop(data.source.id, None) # 取出到达记录

if arrival is None:

return

duration_ns = data.timestamp - arrival.arrival_ts_ns # 核心公式:推出时间 - 到达时间

duration_secs = duration_ns / 1e9

# offset = 该处理器开始的时间点 - 全局起始时间

start_offset_secs = (arrival.arrival_ts_ns - self._start_frame_arrival_ns) / 1e9

self._timings.append(

ProcessorStartupTiming(

processor_name=arrival.processor.name,

start_offset_secs=start_offset_secs, # 可以画 Gantt 图

duration_secs=duration_secs,

)

)

每个 ProcessorStartupTiming 记录了两个维度:

start_offset_secs: 相对于管道启动的偏移(用于时间线/甘特图)duration_secs: 自身start()耗时

报告触发:on_pipeline_started

# startup_timing_observer.py:214-222

async def on_pipeline_started(self):

"""StartFrame 遍历完所有处理器后由 PipelineTask 调用"""

if self._timings:

await self._emit_report()

async def _emit_report(self):

self._startup_timing_reported = True # 防重复

total = sum(t.duration_secs for t in self._timings)

report = StartupTimingReport(

start_time=self._start_wall_clock or 0.0,

total_duration_secs=total,

processor_timings=self._timings,

)

await self._call_event_handler("on_startup_timing_report", report)

为什么不在最后一个 on_push_frame 时发报告? 因为 ParallelPipeline 中多条分支并行处理 StartFrame,Observer 无法知道哪个是"最后一个"。所以用 on_pipeline_started() 这个专门的回调 — 它由 PipelineTask 在确认 StartFrame 遍历完所有分支后才调用。

传输层建连度量(附加功能)

# startup_timing_observer.py:291-312

def _handle_bot_connected(self, data: FramePushed):

"""第一个 BotConnectedFrame → bot 加入房间的延迟"""

if self._bot_connected_secs is not None:

return # 只记第一次

delta_ns = data.timestamp - self._start_frame_arrival_ns

self._bot_connected_secs = delta_ns / 1e9

async def _handle_client_connected(self, data: FramePushed):

"""第一个 ClientConnectedFrame → 客户端连入的延迟,并触发传输报告"""

if self._transport_timing_reported:

return

self._transport_timing_reported = True

delta_ns = data.timestamp - self._start_frame_arrival_ns

report = TransportTimingReport(

start_time=self._start_wall_clock or 0.0,

bot_connected_secs=self._bot_connected_secs, # SFU 传输才有

client_connected_secs=delta_ns / 1e9,

)

await self._call_event_handler("on_transport_timing_report", report)

这巧妙地复用了同一个 Observer 的 on_push_frame 拦截点来追踪额外的帧类型。一个 Observer 可以同时关注多种帧。

完整数据流时序

时间 ──────────────────────────────────────────────────────────────────→

StartFrame 到达 STT StartFrame 离开 STT StartFrame 到达 LLM StartFrame 离开 LLM

│ │ │ │

▼ ▼ ▼ ▼

on_process_frame on_push_frame on_process_frame on_push_frame

记录 arrival[stt] duration = t2 - t1 记录 arrival[llm] duration = t4 - t3

t1 t2 t3 t4

...所有处理器遍历完毕...

on_pipeline_started()

│

▼

emit StartupTimingReport

[STT: 0.12s, LLM: 0.05s, TTS: 0.08s]

4.5.2 TurnTrackingObserver — 会话轮次状态机

源码: src/pipecat/observers/turn_tracking_observer.py

解决的问题: 在语音对话中,如何知道"一轮对话"从哪里开始、到哪里结束?用户打断了怎么算?Bot 说话中间停顿了怎么算?

核心思路:纯粹通过观察帧流来维护状态机

这个 Observer 只用 on_push_frame,不需要 on_process_frame。它不关心帧在哪个处理器被处理,只关心帧的类型和顺序。

状态变量

# turn_tracking_observer.py:46-67

def __init__(self, max_frames=100, turn_end_timeout_secs=2.5, **kwargs):

self._turn_count = 0 # 总轮次计数

self._is_turn_active = False # 当前是否有活跃轮次

self._is_bot_speaking = False # Bot 正在说话?

self._has_bot_spoken = False # 当前轮次中 Bot 是否说过话?

self._turn_start_time = 0 # 当前轮次开始时间(纳秒)

self._turn_end_timeout_secs = turn_end_timeout_secs # 默认 2.5 秒

# 帧去重机制(同一帧可能被多个处理器推送,只处理一次)

self._processed_frames = set()

self._frame_history = deque(maxlen=max_frames) # 有界,防内存泄漏

帧去重机制 — 为什么需要它?

一个帧从 ProcessorA 推送到 ProcessorB 时,on_push_frame 会触发。但同一个帧可能经过多个处理器(A→B→C),每次推送都会触发一次 on_push_frame。状态机只应该对每个帧反应一次。

# turn_tracking_observer.py:78-89

async def on_push_frame(self, data: FramePushed):

if data.frame.id in self._processed_frames:

return # 已处理过,跳过

self._processed_frames.add(data.frame.id)

self._frame_history.append(data.frame.id)

# 有界 deque 满了后会自动丢弃最老的,但 set 不会

# 所以需要定期从 deque 重建 set,防止 set 无限增长

if len(self._processed_frames) > len(self._frame_history):

self._processed_frames = set(self._frame_history)

设计亮点:deque(maxlen=N) + set 组合实现了有界去重。deque 负责自动淘汰最老的 N 个帧 ID,set 负责 O(1) 查重。当 set 比 deque 大时(说明 deque 已自动丢弃了老数据),用 deque 内容重建 set。

状态机完整转换表

# turn_tracking_observer.py:91-104 — 主分发逻辑

if isinstance(data.frame, StartFrame):

if self._turn_count == 0:

await self._start_turn(data) # 管道启动 → 第一轮开始

elif isinstance(data.frame, UserStartedSpeakingFrame):

await self._handle_user_started_speaking(data)

elif isinstance(data.frame, BotStartedSpeakingFrame):

await self._handle_bot_started_speaking(data)

elif isinstance(data.frame, BotStoppedSpeakingFrame) and self._is_bot_speaking:

await self._handle_bot_stopped_speaking(data)

elif isinstance(data.frame, (EndFrame, CancelFrame)):

await self._handle_pipeline_end(data)

| 当前状态 | 触发帧 | 动作 | 新状态 |

|---|---|---|---|

| 无轮次 (count=0) | StartFrame | _start_turn() → 轮次 1 开始 | 轮次活跃 |

| 轮次活跃, Bot 在说话 | UserStartedSpeaking | 结束当前轮(interrupted=True) → 开始新轮 | 新轮次活跃 |

| 轮次活跃, Bot 已说过话, 超时中 | UserStartedSpeaking | 取消超时 → 结束当前轮 → 开始新轮 | 新轮次活跃 |

| 轮次不活跃 | UserStartedSpeaking | _start_turn() | 轮次活跃 |

| 轮次活跃, 用户说话中 | UserStartedSpeaking | 忽略(用户还在同一轮里说话) | 不变 |

| 任意 | BotStartedSpeaking | 标记 bot_speaking=True, 取消超时 | 不变 |

| Bot 在说话 | BotStoppedSpeaking | 标记 bot_speaking=False, 启动超时计时器 | 等待超时 |

| 等待超时, 2.5s 到期 | (timeout) | _end_turn(interrupted=False) | 轮次不活跃 |

| 轮次活跃 | EndFrame/CancelFrame | 强制结束当前轮 | 轮次不活跃 |

打断处理 — 最复杂的分支

# turn_tracking_observer.py:131-149

async def _handle_user_started_speaking(self, data: FramePushed):

if self._is_bot_speaking:

# 场景 1: Bot 正在说话时用户开口 → 打断

self._cancel_turn_end_timer()

await self._end_turn(data, was_interrupted=True) # 结束旧轮

self._is_bot_speaking = False

await self._start_turn(data) # 开始新轮

elif self._is_turn_active and self._has_bot_spoken:

# 场景 2: Bot 停了但还没超时(2.5s 内用户又说话了)

# 这不算打断,但算新轮次的自然开始

self._cancel_turn_end_timer()

await self._end_turn(data, was_interrupted=False)

await self._start_turn(data)

elif not self._is_turn_active:

# 场景 3: 前一轮已结束,用户重新开口

await self._start_turn(data)

else:

# 场景 4: 用户在 Bot 回复前继续说话(比如补充了一句)

logger.trace(f"User is already speaking in Turn {self._turn_count}")

超时计时器 — 为什么不直接在 BotStoppedSpeaking 时结束轮次?

# turn_tracking_observer.py:106-116

def _schedule_turn_end(self, data: FramePushed):

self._cancel_turn_end_timer()

loop = asyncio.get_event_loop()

self._end_turn_timer = loop.call_later(

self._turn_end_timeout_secs, # 默认 2.5 秒

lambda: asyncio.create_task(self._end_turn_after_timeout(data)),

)

原因:Bot 可能中间短暂停顿。 比如:

- Bot 说 “让我查一下…” →

BotStoppedSpeaking - 调用工具,等待 1 秒

- Bot 继续 “查到了,结果是…” →

BotStartedSpeaking

如果在步骤 1 就结束轮次,会把一次完整的对话拆成两轮。2.5 秒超时允许 Bot 在工具调用、HTTP TTS 服务等场景下短暂停顿而不中断轮次。

当 BotStartedSpeaking 在超时内到达时,计时器被取消:

# turn_tracking_observer.py:151-156

async def _handle_bot_started_speaking(self, data: FramePushed):

self._is_bot_speaking = True

self._has_bot_spoken = True

self._cancel_turn_end_timer() # Bot 又开始说话了,取消超时

事件输出

# turn_tracking_observer.py:174-193

async def _start_turn(self, data: FramePushed):

self._is_turn_active = True

self._has_bot_spoken = False

self._turn_count += 1

self._turn_start_time = data.timestamp

await self._call_event_handler("on_turn_started", self._turn_count)

async def _end_turn(self, data: FramePushed, was_interrupted: bool):

if not self._is_turn_active:

return

duration = (data.timestamp - self._turn_start_time) / 1_000_000_000

self._is_turn_active = False

await self._call_event_handler("on_turn_ended", self._turn_count, duration, was_interrupted)

事件参数:

on_turn_started(observer, turn_count)— 第几轮on_turn_ended(observer, turn_count, duration_secs, was_interrupted)— 第几轮、持续多久、是否被打断

4.5.3 UserBotLatencyObserver — 用户到机器人响应延迟

源码: src/pipecat/observers/user_bot_latency_observer.py

解决的问题: 测量"用户说完话到机器人开口"的端到端延迟(即 TTFS — Time to First Speech),并按服务拆分延迟明细(LLM TTFB、TTS TTFB、文本聚合、工具调用)。

核心思路:追踪一个完整的"用户→Bot"响应周期

用户说话中 用户停止说话 STT+分析完成 LLM 响应 TTS 播放

│ │ │ │ │

▼ ▼ ▼ ▼ ▼

VADUserStarted VADUserStopped UserStoppedSpeaking MetricsFrame BotStartedSpeaking

Speaking Speaking Frame (TTFB/TextAgg) │

│ │ │ │ │

│ │◄─── user_turn ────►│ │ │

│ │◄───────────── total latency ─────────────────────────►│

状态与数据结构

# user_bot_latency_observer.py:172-200

def __init__(self, *, max_frames=100, **kwargs):

# 核心时间戳

self._user_stopped_time: Optional[float] = None # VAD 确认用户停止说话的时间

self._user_turn_start_time: Optional[float] = None # 同上(用于 breakdown)

self._user_turn: Optional[float] = None # user turn 持续时间

# 首次 Bot 说话追踪

self._client_connected_time: Optional[float] = None

self._first_bot_speech_measured: bool = False

# 帧去重(同 TurnTrackingObserver)

self._processed_frames: set = set()

self._frame_history: deque = deque(maxlen=max_frames)

# 每轮周期的指标累加器

self._ttfb: List[TTFBBreakdownMetrics] = []

self._text_aggregation: Optional[TextAggregationBreakdownMetrics] = None

self._function_call_starts: Dict[str, tuple[str, float]] = {}

self._function_call_metrics: List[FunctionCallMetrics] = []

帧处理分发 — 只用 on_push_frame + 只看下游

# user_bot_latency_observer.py:206-280

async def on_push_frame(self, data: FramePushed):

if data.direction != FrameDirection.DOWNSTREAM:

return # 只关心下游帧(数据流方向)

# 帧去重(同 TurnTrackingObserver 的 deque+set 方案)

if data.frame.id in self._processed_frames:

return

self._processed_frames.add(data.frame.id)

self._frame_history.append(data.frame.id)

...

完整的帧处理逻辑

1. 用户开始说话 → 重置一切

if isinstance(data.frame, VADUserStartedSpeakingFrame):

self._user_stopped_time = None

self._user_turn_start_time = None

self._user_turn = None

self._reset_accumulators() # 清空 TTFB、文本聚合、工具调用指标

self._first_bot_speech_measured = True # 放弃首次 Bot 说话测量

用户一开口,之前所有累积的指标都作废(可能是被打断了)。

2. VAD 确认用户停止说话 → 记录起始时间

elif isinstance(data.frame, VADUserStoppedSpeakingFrame):

# 关键:减去 stop_secs(VAD 需要的静默检测时间)

# 这样得到的是用户"真正"停止说话的时间

self._user_stopped_time = data.frame.timestamp - data.frame.stop_secs

self._user_turn_start_time = self._user_stopped_time

为什么要减 stop_secs? VAD 需要检测到 N 秒静默后才确认用户停止说话。如果 VAD 在 t=5.3s 触发,stop_secs=0.3s,那用户实际在 t=5.0s 就停了。延迟应该从 5.0s 算起,否则会系统性地低估 0.3s。

3. UserStoppedSpeaking → 计算 user turn 耗时

elif isinstance(data.frame, UserStoppedSpeakingFrame):

if self._user_stopped_time is not None:

self._user_turn = time.time() - self._user_stopped_time

user_turn = 从用户实际停止说话 → 到轮次被释放。这段时间包括:

- VAD 静默检测(

stop_secs) - STT 最终化(等待最终识别结果)

- Turn Analyzer 分析等待(判断用户是否说完了意思)

4. 打断 → 丢弃脏数据

elif isinstance(data.frame, InterruptionFrame):

self._reset_accumulators() # LLM/TTS 被取消了,之前收集的指标无效

5. 工具调用追踪 → 配对计时

elif isinstance(data.frame, FunctionCallInProgressFrame):

# 工具开始执行 → 记录 tool_call_id 和开始时间

self._function_call_starts[data.frame.tool_call_id] = (

data.frame.function_name,

time.time(),

)

elif isinstance(data.frame, FunctionCallResultFrame):

# 工具返回结果 → 计算耗时

start = self._function_call_starts.pop(data.frame.tool_call_id, None)

if start is not None:

function_name, start_time = start

self._function_call_metrics.append(

FunctionCallMetrics(

function_name=function_name,

start_time=start_time,

duration_secs=time.time() - start_time,

)

)

用 tool_call_id 做配对,支持多个工具并发执行。

6. MetricsFrame → 收集服务级 TTFB

elif isinstance(data.frame, MetricsFrame):

self._handle_metrics_frame(data.frame)

# user_bot_latency_observer.py:310-342

def _handle_metrics_frame(self, frame: MetricsFrame):

# 只在有效测量窗口内收集(用户停了或等首次 Bot 说话)

waiting_for_first_speech = (

self._client_connected_time is not None and not self._first_bot_speech_measured

)

if self._user_stopped_time is None and not waiting_for_first_speech:

return

now = time.time()

for metrics_data in frame.data:

if isinstance(metrics_data, TTFBMetricsData) and metrics_data.value > 0:

self._ttfb.append(

TTFBBreakdownMetrics(

processor=metrics_data.processor, # "DeepgramSTT", "OpenAILLM" 等

model=metrics_data.model, # "gpt-4o", "nova-2" 等

start_time=now - metrics_data.value, # 反算开始时间

duration_secs=metrics_data.value,

)

)

elif isinstance(metrics_data, TextAggregationMetricsData):

if self._text_aggregation is None: # 只取第一个(影响首段语音的那个)

self._text_aggregation = TextAggregationBreakdownMetrics(

processor=metrics_data.processor,

start_time=now - metrics_data.value,

duration_secs=metrics_data.value,

)

为什么只取第一个 TextAggregation? 句子聚合器可能产生多次 MetricsFrame(每聚合一句就报一次),但只有第一次影响"首段语音延迟"。后续的聚合和前一段 TTS 并行执行,不计入延迟瓶颈。

7. BotStartedSpeaking → 计算总延迟 + 发射事件

# user_bot_latency_observer.py:282-308

async def _handle_bot_started_speaking(self):

emit_breakdown = False

# 一次性测量:客户端连入 → 首次 Bot 说话(greeting 延迟)

if self._client_connected_time is not None and not self._first_bot_speech_measured:

self._first_bot_speech_measured = True

latency = time.time() - self._client_connected_time

await self._call_event_handler("on_first_bot_speech_latency", latency)

emit_breakdown = True

# 常规测量:用户停止说话 → Bot 开始说话

if self._user_stopped_time is not None:

latency = time.time() - self._user_stopped_time

self._user_stopped_time = None

await self._call_event_handler("on_latency_measured", latency)

emit_breakdown = True

if emit_breakdown:

breakdown = LatencyBreakdown(

ttfb=list(self._ttfb),

text_aggregation=self._text_aggregation,

user_turn_start_time=self._user_turn_start_time,

user_turn_secs=self._user_turn,

function_calls=list(self._function_call_metrics),

)

await self._call_event_handler("on_latency_breakdown", breakdown)

self._reset_accumulators()

LatencyBreakdown 数据模型 — 按时间排序的事件链

# user_bot_latency_observer.py:114-141

class LatencyBreakdown(BaseModel):

ttfb: List[TTFBBreakdownMetrics] # LLM TTFB, TTS TTFB

text_aggregation: Optional[TextAggregationBreakdownMetrics] # 句子聚合延迟

user_turn_start_time: Optional[float] # 用户停止说话的时间

user_turn_secs: Optional[float] # VAD+STT+分析器延迟

function_calls: List[FunctionCallMetrics] # 工具调用延迟

def chronological_events(self) -> List[str]:

"""按时间排序输出人类可读的事件链"""

events = []

if self.user_turn_start_time and self.user_turn_secs:

events.append((self.user_turn_start_time, f"User turn: {self.user_turn_secs:.3f}s"))

for t in self.ttfb:

events.append((t.start_time, f"{t.processor}: TTFB {t.duration_secs:.3f}s"))

for fc in self.function_calls:

events.append((fc.start_time, f"{fc.function_name}: {fc.duration_secs:.3f}s"))

if self.text_aggregation:

ta = self.text_aggregation

events.append((ta.start_time, f"{ta.processor}: text aggregation {ta.duration_secs:.3f}s"))

events.sort(key=lambda e: e[0])

return [label for _, label in events]

输出示例:

User turn: 0.482s

DeepgramSTT: TTFB 0.123s

OpenAILLM: TTFB 0.341s

get_weather: 0.892s

ElevenLabsTTS: TTFB 0.187s

SentenceAggregator: text aggregation 0.045s

三个事件的语义区分

| 事件 | 触发条件 | 语义 |

|---|---|---|

on_first_bot_speech_latency | 客户端连入后首次 BotStartedSpeaking,只触发一次 | 衡量 greeting 延迟(用户刚进来到 Bot 说第一句话) |

on_latency_measured | 每次用户停止说话后 BotStartedSpeaking | 衡量单轮用户→Bot 响应延迟 |

on_latency_breakdown | 与上两个同时触发 | 提供按服务拆分的延迟明细 |

4.5.4 三个 Observer 的设计模式对比

| 维度 | StartupTiming | TurnTracking | UserBotLatency |

|---|---|---|---|

| 用到的拦截点 | on_process_frame + on_push_frame | 仅 on_push_frame | 仅 on_push_frame |

| 关注的帧类型 | StartFrame, BotConnected, ClientConnected | StartFrame, UserStarted/Stopped, BotStarted/Stopped, End/Cancel | VADUserStarted/Stopped, UserStopped, BotStarted, Interruption, FunctionCall*, Metrics, ClientConnected |

| 状态复杂度 | 低(map + list) | 中(状态机 + 计时器) | 高(多指标累加器 + 配对追踪) |

| 帧去重 | 不需要(只看 StartFrame,用 frame.id 锁定) | 需要(deque+set) | 需要(deque+set) |

| 触发频率 | 一次性(启动时) | 每轮一次 | 每轮一次 |

| 核心技巧 | 两个拦截点的时间差 | 帧序列 → 状态转换 | 帧序列 → 指标收集 → 打包发射 |

4.6 Observer 解决了什么问题?

没有 Observer 时(强耦合方式):

class MySTTService(STTService):

async def process_frame(self, frame, direction):

# ❌ 业务逻辑和打点代码交织在一起

start = time.time()

logger.info(f"Processing {frame}")

metrics.record("stt_process_start", start)

result = await self._recognize(frame) # 真正的业务逻辑

elapsed = time.time() - start

metrics.record("stt_latency", elapsed)

logger.info(f"STT took {elapsed:.3f}s")

await self.push_frame(result)

有 Observer 时(彻底解耦):

# STT 服务只关心业务

class MySTTService(STTService):

async def process_frame(self, frame, direction):

result = await self._recognize(frame)

await self.push_frame(result)

# 性能监控独立为 Observer,零侵入

observer = StartupTimingObserver()

@observer.event_handler("on_startup_timing_report")

async def on_report(observer, report):

for t in report.processor_timings:

print(f"{t.processor_name}: {t.duration_secs:.3f}s")

task = PipelineTask(pipeline, observers=[observer])

| 维度 | 无 Observer | 有 Observer |

|---|---|---|

| 服务代码 | 充斥打点/日志代码 | 纯业务逻辑 |

| 添加新指标 | 修改每个服务 | 新增一个 Observer |

| 移除监控 | 修改每个服务 | 不传 Observer 即可 |

| 监控影响管道 | 可能(慢日志阻塞) | 不可能(队列隔离) |

| 运行时切换 | 困难 | add_observer() / remove_observer() |

4.7 与 Spring AOP 的类比

| Spring AOP 概念 | Pipecat Observer 对应 |

|---|---|

JoinPoint (连接点) | FrameProcessed / FramePushed 数据对象 |

Pointcut (切点) | 固定两个: process_frame() 入口 + __internal_push_frame() 出口 |

Advice (通知) | on_process_frame() = @Before, on_push_frame() = @AfterReturning |

Aspect (切面) | 一个 BaseObserver 子类 = 一个切面 |

Weaving (织入) | FrameProcessorSetup 将 TaskObserver 注入所有处理器 |

Proxy (代理) | TaskObserver 用队列+协程代理所有 Observer |

关键差异: Spring AOP 的切点可以用表达式匹配任意方法,Pipecat 的切点是固定的两个位置。这是刻意的设计简化 — 对于管道架构来说,“帧进入” 和 “帧离开” 两个点就足以覆盖所有监控需求(耗时 = 出 - 入,流量 = 计数推送次数,状态 = 观察帧类型序列)。

五、Speech Input & Turn Detection:语音输入与轮次检测

语音对话的核心挑战是:如何判断用户什么时候开始说话、什么时候说完了?

这不是简单的"检测到声音=开始,没声音=结束"。用户会停顿思考、会被噪音干扰、会在句子中间换气。Pipecat 通过一个多层策略架构来解决这个问题。

5.1 整体架构:三层检测管道

原始音频流 ──→ [VAD 层] ──→ [Turn Start 策略层] ──→ [Turn Stop 策略层] ──→ 管道下游

│ │ │ │

│ ▼ ▼ ▼

│ VADUserStarted UserStartedSpeaking UserStoppedSpeaking

│ VADUserStopped + 中断 + 触发 LLM

│ │ │ │

└──→ [STT 服务] ──→ TranscriptionFrame ──────────────→ ─┘

三层各司其职:

| 层级 | 组件 | 输入 | 输出 | 关注点 |

|---|---|---|---|---|

| 第一层:VAD | VADAnalyzer + VADController | 原始音频 PCM | VADUserStarted/StoppedSpeakingFrame | 物理层面的声音活动检测 |

| 第二层:Turn Start | BaseUserTurnStartStrategy 实现 | VAD帧、转录帧 | UserStartedSpeakingFrame + 中断 | 决定"用户开始了一个新轮次" |

| 第三层:Turn Stop | BaseUserTurnStopStrategy 实现 | VAD帧、转录帧、音频帧 | UserStoppedSpeakingFrame | 决定"用户说完了,可以回应" |

关键区别:VAD 帧是物理层信号(“检测到声音/停止声音”),User 帧是语义层信号(“用户开始了一个对话轮次/完成了对话轮次”)。

5.2 第一层:VAD — 声音活动检测

Source: src/pipecat/audio/vad/

5.2.1 VADAnalyzer:四态状态机

VAD 的核心是一个四态状态机,通过计数确认机制避免误检:

# vad_analyzer.py:31-44

class VADState(Enum):

QUIET = 1 # 安静

STARTING = 2 # 可能开始说话(需要确认)

SPEAKING = 3 # 确认正在说话

STOPPING = 4 # 可能停止说话(需要确认)

状态转换逻辑(_run_analyzer 方法):

confidence >= threshold

QUIET ──────────────────────────────→ STARTING

↑ │

│ confidence < threshold │ 连续 start_frames 次

│ (reset counter) ▼

├────────────────────────────── SPEAKING

│ │

│ 连续 stop_frames 次 │ confidence < threshold

│ ▼

└────────────────────────────── STOPPING

confidence >= threshold │

(reset, back to SPEAKING) ←───────┘

设计决策:计数确认(Debouncing)

# vad_analyzer.py:207-244

speaking = confidence >= self._params.confidence and volume >= self._params.min_volume

if speaking:

match self._vad_state:

case VADState.QUIET:

self._vad_state = VADState.STARTING

self._vad_starting_count = 1 # 开始计数

case VADState.STARTING:

self._vad_starting_count += 1 # 继续计数

case VADState.STOPPING:

self._vad_state = VADState.SPEAKING # 取消停止,回到说话

self._vad_stopping_count = 0

# 只有连续达到阈值帧数才确认状态转换

if self._vad_state == VADState.STARTING and self._vad_starting_count >= self._vad_start_frames:

self._vad_state = VADState.SPEAKING # 确认开始说话

为什么不是简单的"检测到声音就开始"?因为:

start_secs=0.2:需要持续 200ms 的语音才确认开始,过滤掉咳嗽、键盘声等stop_secs=0.2:需要持续 200ms 的静音才确认结束,允许正常的句内停顿min_volume=0.6:额外的音量阈值,防止低音量噪声触发 VADconfidence=0.7:模型置信度阈值

帧数计算公式:

# vad_analyzer.py:161-164

vad_frames_per_sec = self._vad_frames / self.sample_rate # 一帧的时长

self._vad_start_frames = round(start_secs / vad_frames_per_sec) # 需要多少帧

self._vad_stop_frames = round(stop_secs / vad_frames_per_sec)

5.2.1.1 这段代码真正做了什么?

如果只看设计意图,VADAnalyzer 解决的问题不是“识别一句话的语义”,而是:

把连续不断到来的 PCM 字节流,切成模型能处理的固定窗口,并且把窗口级别的不稳定判断,压缩成一个稳定的语音活动状态。

从代码看,这个过程分成三步:

第一步:先累积字节,直到够一个分析窗口

# vad_analyzer.py

self._vad_buffer += buffer

num_required_bytes = self._vad_frames_num_bytes

if len(self._vad_buffer) < num_required_bytes:

return self._vad_state

这意味着:不是每次收到 transport 的一块音频就立刻跑一次 VAD。

VAD 先把数据攒起来,等长度达到 num_frames_required() 对应的字节数,才真正做一次判断。

第二步:从固定窗口里算两个信号

# vad_analyzer.py

confidence = self.voice_confidence(audio_frames)

volume = self._get_smoothed_volume(audio_frames)

self._prev_volume = volume

speaking = confidence >= self._params.confidence and volume >= self._params.min_volume

这里有两个输入信号:

confidence:VAD 模型判断“这像不像语音”的概率volume:当前音量大小,而且做了指数平滑

作者的意图很明确:不要只信模型概率,也不要只信音量,必须两者都过线。

第三步:把窗口级别判断压成状态机

# vad_analyzer.py

if speaking:

match self._vad_state:

case VADState.QUIET:

self._vad_state = VADState.STARTING

self._vad_starting_count = 1

case VADState.STARTING:

self._vad_starting_count += 1

case VADState.STOPPING:

self._vad_state = VADState.SPEAKING

self._vad_stopping_count = 0

else:

match self._vad_state:

case VADState.STARTING:

self._vad_state = VADState.QUIET

self._vad_starting_count = 0

case VADState.SPEAKING:

self._vad_state = VADState.STOPPING

self._vad_stopping_count = 1

case VADState.STOPPING:

self._vad_stopping_count += 1

这段代码的本质是:窗口判断是离散抖动的,状态机输出才是连续稳定的。

5.2.1.2 为什么还要算音量,而且要做平滑?

平滑音量的代码很短,但设计上很关键:

# vad_analyzer.py

def _get_smoothed_volume(self, audio: bytes) -> float:

volume = calculate_audio_volume(audio, self.sample_rate)

return exp_smoothing(volume, self._prev_volume, self._smoothing_factor)

作者想解决的是两个问题:

- 瞬时尖峰噪音:比如键盘、敲桌子、轻微碰撞

- 模型置信度偶发偏高:模型可能在某些非语音片段上也打出较高分

所以这里没有用“当前原始音量”直接判定,而是:

- 先算窗口音量

- 再和上一时刻的音量做指数平滑

这样一来,VAD 不会因为某个极短的脉冲噪音就立刻抖成 STARTING / SPEAKING。

5.2.1.3 start_secs / stop_secs 在代码里的精确定义

这两个参数经常被误解成“语音开始延迟”和“语音结束延迟”。更准确地说,它们表示:

在窗口级别判断已经满足 speaking / non-speaking 的情况下,还需要连续满足多久,状态机才会承认这个变化。

换句话说:

start_secs不是 transport 延迟,而是 进入SPEAKING之前的确认窗口stop_secs不是简单静音长度,而是 退出SPEAKING之前的确认窗口

所以这两个值影响的不只是 VAD 自己,还会传导到:

- turn detection 的时机

- STT finalization 的超时补偿

- 用户感知到的交互灵敏度

5.2.1.4 为什么 analyze_audio() 要跑在线程池里?

# vad_analyzer.py

async def analyze_audio(self, buffer: bytes) -> VADState:

loop = asyncio.get_running_loop()

state = await loop.run_in_executor(self._executor, self._run_analyzer, buffer)

return state

这里的意图不是“为了并行更快”,而是两个更实际的目标:

- 不阻塞 asyncio 事件循环

- 保证单个音频流上的状态机串行执行

因为:

- 模型推理和 numpy 处理都可能占用 CPU

_vad_buffer、_vad_state、计数器这些状态都不是线程安全共享结构

所以作者选的是一个折中方案:

- 每个 analyzer 一个

ThreadPoolExecutor(max_workers=1) - 既避免阻塞主事件循环

- 又保证同一条音频流的 VAD 状态按顺序推进

5.2.2 VADController:事件桥接

VADController 把 VADAnalyzer 的状态变化转换为事件:

# vad_controller.py:126-140

async def _handle_vad(self, audio: bytes, vad_state: VADState) -> VADState:

new_vad_state = await self._vad_analyzer.analyze_audio(audio)

# 只关心 SPEAKING 和 QUIET 的变化(忽略中间态 STARTING/STOPPING)

if new_vad_state != vad_state \

and new_vad_state != VADState.STARTING \

and new_vad_state != VADState.STOPPING:

if new_vad_state == VADState.SPEAKING:

await self._call_event_handler("on_speech_started")

elif new_vad_state == VADState.QUIET:

await self._call_event_handler("on_speech_stopped")

return new_vad_state

关键设计:同步事件处理器。 所有事件注册为 sync=True:

# vad_controller.py:84-88

self._register_event_handler("on_speech_started", sync=True)

self._register_event_handler("on_speech_stopped", sync=True)

self._register_event_handler("on_speech_activity", sync=True)

为什么同步?因为 VAD 事件处理器的响应(生成 VADUserStartedSpeakingFrame)需要在下一个音频帧到达之前完成,如果异步调度可能丢失时序。

5.2.2.1 VADController 到底解决了什么问题?

VADAnalyzer 只会返回一个内部状态:QUIET / STARTING / SPEAKING / STOPPING。

但 pipeline 其他处理器不能直接依赖这个内部状态对象,否则:

- 所有处理器都要懂 VAD 状态机细节

- 所有处理器都要自己处理过渡态

- 状态变化和 frame 广播逻辑会散落在各处

所以 VADController 的真正意图是:

把“VAD 内部状态变化”提升成“对外可消费的语音事件”。

从代码上看,它只做三件事:

# vad_controller.py

if isinstance(frame, StartFrame):

await self._start(frame)

elif isinstance(frame, InputAudioRawFrame):

await self._handle_audio(frame)

elif isinstance(frame, VADParamsUpdateFrame):

self._vad_analyzer.set_params(frame.params)

await self.broadcast_frame(SpeechControlParamsFrame, vad_params=frame.params)

也就是说,它是一个非常薄的 orchestration 层:

StartFrame:初始化 sample rate,并广播初始参数InputAudioRawFrame:送给 analyzer 做检测VADParamsUpdateFrame:热更新参数,并同步通知下游

5.2.2.2 为什么要忽略 STARTING / STOPPING?

这是 VADController 最重要的设计选择之一:

# vad_controller.py

if (

new_vad_state != vad_state

and new_vad_state != VADState.STARTING

and new_vad_state != VADState.STOPPING

):

if new_vad_state == VADState.SPEAKING:

await self._call_event_handler("on_speech_started")

elif new_vad_state == VADState.QUIET:

await self._call_event_handler("on_speech_stopped")

作者故意不把过渡态传播出去,原因是:

STARTING/STOPPING只是内部防抖细节,不应该成为 pipeline 级别的公共协议。

否则上层 turn strategy、STT、metrics、observer 都要理解:

- “这是真的开始了吗?”

- “这只是准备停止,还是已经停止?”

这样会把本来应该封装在 VAD 内部的复杂度泄漏出去。

所以对外只暴露两个稳定边界:

SPEAKING:确认已经开始说话QUIET:确认已经停止说话

5.2.2.3 on_speech_activity 为什么存在?

除了 started/stopped,controller 还会在 SPEAKING 状态下持续触发 activity:

# vad_controller.py

self._vad_state = await self._handle_vad(frame.audio, self._vad_state)

if self._vad_state == VADState.SPEAKING:

await self._call_event_handler("on_speech_activity")

这个事件不是“边界事件”,而是“持续活动信号”。

它的设计意图是给上层一个更轻量的提示:

- 用户还在说话

- 可以更新 UI speaking indicator

- 可以周期性发

UserSpeakingFrame - 可以供 observer/metrics 记录“讲话进行中”

所以:

on_speech_started/on_speech_stopped是边界on_speech_activity是心跳

5.2.2.4 初始参数为什么要通过 SpeechControlParamsFrame 广播?

StartFrame 时 controller 会做一件很容易被忽略的事:

# vad_controller.py

async def _start(self, frame: StartFrame):

self._vad_analyzer.set_sample_rate(frame.audio_in_sample_rate)

await self.broadcast_frame(SpeechControlParamsFrame, vad_params=self._vad_analyzer.params)

这背后的意图是:

VAD 参数不是 VAD 自己私有的,它们会影响其他依赖时序补偿的处理器。

比如:

- STT service 可能需要知道 VAD 参数做 latency/TTFB 推断

- turn analyzer 可能要根据

start_secs/stop_secs修正时间窗口

所以 VAD 初始化不是“自己 set 一下 sample rate 就结束”,而是会把参数广播成系统级控制信息。

5.2.3 VAD 实现

Pipecat 提供两种 VAD 实现:

| 实现 | 文件 | 模型 | 特点 |

|---|---|---|---|

SileroVADAnalyzer | silero.py | Silero ONNX | 独立部署,支持 8kHz/16kHz |

WebRTCVADAnalyzer | daily/transport.py | Daily 原生 WebRTC VAD | 依赖 Daily SDK |

AICVADAnalyzer | aic_vad.py | AIC SDK | 延迟绑定工厂模式 |

线程模型: VAD 模型推理在独立的 ThreadPoolExecutor(max_workers=1) 中运行:

# vad_analyzer.py:91,186-188

self._executor = ThreadPoolExecutor(max_workers=1)

async def analyze_audio(self, buffer: bytes) -> VADState:

loop = asyncio.get_running_loop()

state = await loop.run_in_executor(self._executor, self._run_analyzer, buffer)

return state

这保证了 VAD 推理不会阻塞事件循环,同时单线程保证了状态一致性。

5.2.3.1 默认实现 SileroVADAnalyzer 具体怎么跑?

默认最常见的是 SileroVADAnalyzer。它实现了 voice_confidence(),也就是:

给固定长度的 PCM 窗口,返回一个“像不像语音”的置信度。

关键代码在 silero.py:

# silero.py

def voice_confidence(self, buffer) -> float:

audio_int16 = np.frombuffer(buffer, np.int16)

audio_float32 = np.frombuffer(audio_int16, dtype=np.int16).astype(np.float32) / 32768.0

new_confidence = self._model(audio_float32, self.sample_rate)[0]

...

return new_confidence

这段代码做了三件事:

- 把

bytes解释成 int16 PCM - 归一化到

[-1, 1]的 float32 - 喂给 Silero ONNX 模型,拿到概率值

也就是说,SileroVADAnalyzer 并不直接发 frame,它只负责:

PCM bytes -> confidence

真正的状态稳定化仍然由 VADAnalyzer 基类完成。

5.2.3.2 为什么 num_frames_required() 固定成 512 / 256?

# silero.py

def num_frames_required(self) -> int:

return 512 if self.sample_rate == 16000 else 256

这不是随便选的 chunk 大小,而是 Silero 模型输入规格。

对应关系是:

- 16kHz 输入时,每次要 512 个 sample

- 8kHz 输入时,每次要 256 个 sample

所以 VADAnalyzer 里的 _vad_buffer 本质上是在做一件事:

把 transport 下游传来的任意大小音频块,重新拼接成 VAD 模型所要求的固定窗口。

5.2.3.3 为什么模型状态要周期性 reset?

Silero 实现里还有一个很关键的小细节:

# silero.py

if diff_time >= _MODEL_RESET_STATES_TIME:

self._model.reset_states()

self._last_reset_time = curr_time

这里的设计意图不是为了“让模型更准”,而是为了工程稳定性:

- Silero ONNX 模型内部维护上下文状态

- 长时间连续运行可能会让内部状态和内存持续累积

所以作者每隔一段时间主动 reset 一次,目的是:

- 避免长期运行时状态漂移

- 控制资源占用

- 保持服务型场景下的稳定性

5.2.4 从 VAD 事件到关键 Frame:谁在发 VADUserStartedSpeakingFrame?

这一层不在 audio/vad/ 目录里,而是在 LLMUserAggregator 里完成。

LLMUserAggregator.process_frame() 每收到一个 frame,都会先把音频交给 VADController:

# llm_response_universal.py

if self._vad_controller:

await self._vad_controller.process_frame(frame)

然后 aggregator 通过 event handler,把 VAD 事件包装成真正流进 pipeline 的 frame:

# llm_response_universal.py

async def _on_vad_speech_started(self, controller):

await self._queued_broadcast_frame(

VADUserStartedSpeakingFrame,

start_secs=controller._vad_analyzer.params.start_secs,

)

async def _on_vad_speech_stopped(self, controller):

await self._queued_broadcast_frame(

VADUserStoppedSpeakingFrame,

stop_secs=controller._vad_analyzer.params.stop_secs,

)

async def _on_vad_speech_activity(self, controller):

await self._queued_broadcast_frame(UserSpeakingFrame)

这说明:

VADAnalyzer不发 frameVADController也不直接发 frame 对象,它只发事件- 真正把事件翻译成 frame 的,是聚合器这一层

作者这样拆的意图是:

把底层检测逻辑和 pipeline 协议解耦。

如果以后更换 VAD 实现,只要还能触发同样的 started/stopped/activity 事件,上层 frame 协议完全不需要变。

5.2.4.1 为什么是 _queued_broadcast_frame() 而不是直接 push_frame()?

_queued_broadcast_frame() 会做两件事:

- 把 frame 排队给自己内部再处理一次

- 同时把 frame 向 upstream 广播出去

对应代码:

# llm_response_universal.py

async def _queued_broadcast_frame(self, frame_cls: Type[Frame], **kwargs):

await self._internal_queue_frame(frame_cls(**kwargs))

await self.push_frame(frame_cls(**kwargs), FrameDirection.UPSTREAM)

它的意图是:

- 对外:让 pipeline 其他处理器立刻收到

VADUserStartedSpeakingFrame - 对内:让 aggregator 自己的

UserTurnController也走一遍同样的 frame 流程

这样整个系统看到的是统一的 frame 流,而不是“有些状态只存在于对象内部,有些状态才发进 pipeline”。

5.2.4.2 VAD 最终发出的关键 frame 有哪些?

从代码看,VAD 直接相关的关键 frame 有三类:

| Frame | 谁发出 | 含义 |

|---|---|---|

VADUserStartedSpeakingFrame | LLMUserAggregator | 原始 VAD 已确认进入 SPEAKING |

VADUserStoppedSpeakingFrame | LLMUserAggregator | 原始 VAD 已确认回到 QUIET |

UserSpeakingFrame | LLMUserAggregator | 用户当前仍在说话中的活动心跳 |

这些 frame 的语义是物理层的,不是最终对话轮次:

- 它们表示“检测到语音活动”

- 不表示“用户的一轮输入已经开始/结束”

真正的语义层 frame 是后续策略层发出的:

UserStartedSpeakingFrameUserStoppedSpeakingFrame

所以可以把整个 VAD 链路理解为:

InputAudioRawFrame

-> VADAnalyzer (confidence + volume + state machine)

-> VADController (started/stopped/activity events)

-> LLMUserAggregator (wrap into VAD frames)

-> UserTurnController / strategies

-> semantic user turn frames

5.3 第二层:Turn Start 策略 — 决定何时开始轮次

Source: src/pipecat/turns/user_start/

Turn Start 策略回答一个问题:用户是否开始了一个新的对话轮次?

5.3.1 策略基类

# base_user_turn_start_strategy.py

class BaseUserTurnStartStrategy(BaseObject):

def __init__(self, *, enable_interruptions=True, enable_user_speaking_frames=True):

# enable_interruptions: 触发时是否中断当前 bot 输出

# enable_user_speaking_frames: 是否广播 UserStartedSpeakingFrame

async def process_frame(self, frame: Frame):

"""子类重写,判断是否触发 turn start"""

pass

async def trigger_user_turn_started(self):

"""触发 on_user_turn_started 事件,携带参数"""

await self._call_event_handler("on_user_turn_started",

UserTurnStartedParams(

enable_interruptions=self._enable_interruptions,

enable_user_speaking_frames=self._enable_user_speaking_frames,

))

5.3.2 四种内置策略

1. VADUserTurnStartStrategy — 最常用,VAD 触发即开始

# vad_user_turn_start_strategy.py — 完整实现仅 ~10 行

class VADUserTurnStartStrategy(BaseUserTurnStartStrategy):

async def process_frame(self, frame: Frame):

await super().process_frame(frame)

if isinstance(frame, VADUserStartedSpeakingFrame):

await self.trigger_user_turn_started()

逻辑极简:VAD 说开始了,Turn 就开始了。这是默认的第一策略。

2. TranscriptionUserTurnStartStrategy — 后备策略,STT 检测到文字即开始

当 VAD 未检测到语音但 STT 返回了转录时作为后备触发。例如:音量太低未达到 VAD 阈值,但 STT 仍然识别出了文字。这是默认的第二策略。

3. MinWordsUserTurnStartStrategy — 需要最少单词数

需要至少 N 个单词才触发开始。适用于需要防止单字误触发的场景。

4. ExternalUserTurnStartStrategy — 外部控制

等待外部组件推送 UserStartedSpeakingFrame。禁用中断和 speaking 帧。用于由 STT 服务或其他外部组件直接控制轮次的场景。

5.3.3 默认策略组合

# user_turn_strategies.py:46-50

class UserTurnStrategies:

def __post_init__(self):

if not self.start:

self.start = [VADUserTurnStartStrategy(), TranscriptionUserTurnStartStrategy()]

if not self.stop:

self.stop = [TurnAnalyzerUserTurnStopStrategy(turn_analyzer=LocalSmartTurnAnalyzerV3())]

默认组合 = VAD 优先 + STT 后备。两个策略同时运行,任何一个触发就算开始(first-wins 语义)。

5.4 第三层:Turn Stop 策略 — 决定何时结束轮次

Source: src/pipecat/turns/user_stop/

Turn Stop 是整个系统中最复杂的部分。它需要回答一个很难的问题:用户是真的说完了,还是只是在停顿?

5.4.1 TurnAnalyzerUserTurnStopStrategy — 基于 ML 模型的轮次结束检测

这是默认的 stop 策略,使用机器学习模型判断用户是否说完。

核心状态变量:

# turn_analyzer_user_turn_stop_strategy.py

self._turn_analyzer = turn_analyzer # ML 模型

self._stt_timeout: float = 0.0 # STT P99 延迟(从 STTMetadataFrame 获取)

self._stop_secs: float = 0.0 # VAD stop_secs

self._text = "" # 累积的转录文本

self._turn_complete = False # 模型是否判断 turn 完成

self._vad_user_speaking = False # VAD 是否检测到语音

self._transcript_finalized = False # 是否收到 finalized transcript

处理流程:

VADUserStartedSpeaking ──→ 重置状态,取消超时

vad_user_speaking = True

InputAudioRawFrame ──────→ turn_analyzer.append_audio(audio, is_speech)

如果流式模型返回 COMPLETE → turn_complete = True

VADUserStoppedSpeaking ──→ vad_user_speaking = False

turn_analyzer.analyze_end_of_turn()

如果批量模型返回 COMPLETE → turn_complete = True

启动 STT 超时任务 (timeout = stt_timeout - stop_secs)

TranscriptionFrame ──────→ text = frame.text

如果 finalized → transcript_finalized = True

→ _maybe_trigger_user_turn_stopped()

超时到达 ────────────────→ _maybe_trigger_user_turn_stopped()

触发条件(_maybe_trigger_user_turn_stopped):

# turn_analyzer_user_turn_stop_strategy.py:205-227

async def _maybe_trigger_user_turn_stopped(self):

# 必须有转录文本 AND 模型判断 turn 完成

if not self._text or not self._turn_complete:

return

# finalized transcript → 立即触发

if self._transcript_finalized:

await self.trigger_user_turn_stopped()

return

# 非 finalized → 只在超时任务完成后触发

if self._timeout_task is None:

await self.trigger_user_turn_stopped()

超时补偿设计:

# turn_analyzer_user_turn_stop_strategy.py:155-159

# VAD 的 stop_secs 已经过去了(那段时间是 VAD 在等待确认静音)

# 所以 STT 超时需要减去这段时间

timeout = max(0, self._stt_timeout - self._stop_secs)

为什么要减去 stop_secs?时间线:

用户实际停止说话

│

├── stop_secs (0.2s) ──→ VAD 确认静音,发出 VADUserStoppedSpeaking

│ │

│ ├── (stt_timeout - stop_secs) ──→ 超时触发

如果不减,超时等待会过长,因为 VAD 确认静音时 STT 已经在处理了。

5.4.2 SpeechTimeoutUserTurnStopStrategy — 基于超时的简单策略

不使用 ML 模型,纯基于时间:

# speech_timeout_user_turn_stop_strategy.py:145-158

def _calculate_timeout(self) -> float:

effective_stt_wait = max(0, self._stt_timeout - self._stop_secs)

if self._transcript_finalized:

return self._user_speech_timeout # 已有最终转录,只等用户恢复说话

return max(effective_stt_wait, self._user_speech_timeout) # 取大值

user_speech_timeout=0.6s 是给用户的"恢复说话窗口"。如果在这段时间内用户又开始说话(VAD 触发),超时任务会被取消。

5.4.3 ExternalUserTurnStopStrategy

等待外部 UserStoppedSpeakingFrame,与 ExternalUserTurnStartStrategy 配套使用。

5.4.4 BaseTurnAnalyzer — ML 模型接口

# audio/turn/base_turn_analyzer.py

class BaseTurnAnalyzer(ABC):

@abstractmethod

def append_audio(self, buffer: bytes, is_speech: bool) -> EndOfTurnState:

"""逐帧添加音频。流式分析器可能在此返回 COMPLETE。"""

@abstractmethod

async def analyze_end_of_turn(self) -> Tuple[EndOfTurnState, Optional[MetricsData]]:

"""批量分析是否 turn 完成。在 VAD 停止时调用。"""

def update_vad_start_secs(self, vad_start_secs: float):

"""同步 VAD 的 start 延迟,调整预缓冲大小。"""

两种分析模式:

| 模式 | 代表实现 | append_audio | analyze_end_of_turn | 特点 |

|---|---|---|---|---|

| 流式 | KrispVivaTurn | 返回 COMPLETE | 确认 | 实时逐帧判断 |

| 批量 | LocalSmartTurnAnalyzerV3 | 总是 INCOMPLETE | 返回结果 | VAD 停止时一次性分析 |

默认使用 LocalSmartTurnAnalyzerV3(本地 ML 模型,V3 版本)。

5.5 UserTurnController — 策略编排器

Source: src/pipecat/turns/user_turn_controller.py

Controller 负责协调所有策略,管理轮次状态,防止重复触发:

# user_turn_controller.py

class UserTurnController(BaseObject):

def __init__(self, *, user_turn_strategies, user_turn_stop_timeout=5.0):

self._user_turn = False # 当前是否在一个轮次中

self._user_speaking = False # 用户是否正在说话

核心调度逻辑:

# user_turn_controller.py:141-167

async def process_frame(self, frame: Frame):

# 1. 先处理 VAD/User speaking 状态(重置超时)

if isinstance(frame, UserStartedSpeakingFrame):

self._user_speaking = True

self._user_turn_stop_timeout_event.set() # 重置超时

elif isinstance(frame, VADUserStartedSpeakingFrame):

self._user_speaking = True

self._user_turn_stop_timeout_event.set()

# ... 类似处理 stopped 和 transcription

# 2. 分发给所有 start 策略

for strategy in self._user_turn_strategies.start or []:

await strategy.process_frame(frame)

# 3. 分发给所有 stop 策略

for strategy in self._user_turn_strategies.stop or []:

await strategy.process_frame(frame)

防重复触发:

# user_turn_controller.py:245-259

async def _trigger_user_turn_start(self, strategy, params):

if self._user_turn: # 已经在轮次中,忽略

return

self._user_turn = True

# 重置所有 start 策略

for s in self._user_turn_strategies.start or []:

await s.reset()

await self._call_event_handler("on_user_turn_started", strategy, params)

async def _trigger_user_turn_stop(self, strategy, params):

if not self._user_turn: # 不在轮次中,忽略

return

self._user_turn = False

# 重置所有 stop 策略

for s in self._user_turn_strategies.stop or []:

await s.reset()

await self._call_event_handler("on_user_turn_stopped", strategy, params)

超时保护:

# user_turn_controller.py:277-290

async def _user_turn_stop_timeout_task_handler(self):

while True:

try:

await asyncio.wait_for(

self._user_turn_stop_timeout_event.wait(),

timeout=self._user_turn_stop_timeout, # 默认 5.0s

)

self._user_turn_stop_timeout_event.clear()

except asyncio.TimeoutError:

# 5秒内没有任何活动 → 强制结束轮次

if self._user_turn and not self._user_speaking:

await self._trigger_user_turn_stop(None, UserTurnStoppedParams(...))

超时事件(_user_turn_stop_timeout_event)在以下情况重置:

- 用户开始/停止说话

- VAD 开始/停止

- 收到转录

如果 5 秒内都没有上述活动且用户不在说话 → 自动结束轮次。

5.6 UserTurnProcessor — FrameProcessor 包装

Source: src/pipecat/turns/user_turn_processor.py

将 Controller 包装为 FrameProcessor,接入管道:

# user_turn_processor.py:115-147

async def process_frame(self, frame: Frame, direction: FrameDirection):

await super().process_frame(frame, direction)

# 1. 先推送帧给下游(StartFrame/EndFrame 必须先到达所有处理器)

if isinstance(frame, StartFrame):

await self.push_frame(frame, direction)

await self._start(frame) # 初始化 controller

elif isinstance(frame, EndFrame):

await self.push_frame(frame, direction)

await self._stop(frame)

else:

await self.push_frame(frame, direction)

# 2. 交给 controller 处理

await self._user_turn_controller.process_frame(frame)

# 3. 交给 idle controller 处理

await self._user_idle_controller.process_frame(frame)

事件处理:当 turn start 触发时

# user_turn_processor.py:171-187

async def _on_user_turn_started(self, controller, strategy, params):

# 1. 广播 UserStartedSpeakingFrame(如果策略允许)

if params.enable_user_speaking_frames:

await self.broadcast_frame(UserStartedSpeakingFrame)

# 2. 中断当前 bot 输出(如果策略允许且处理器允许)

if params.enable_interruptions and self._allow_interruptions:

await self.broadcast_interruption()

# 3. 触发外部事件

await self._call_event_handler("on_user_turn_started", strategy)

5.7 UserIdleController — 用户闲置检测

Source: src/pipecat/turns/user_idle_controller.py

检测用户在 bot 说完后长时间不说话的场景:

# user_idle_controller.py:95-136

async def process_frame(self, frame: Frame):

if isinstance(frame, BotStoppedSpeakingFrame):

# Bot 说完了 → 启动闲置计时器

# 但要排除:用户正在说话(中断场景)、function call 进行中

if not self._user_turn_in_progress and self._function_calls_in_progress == 0:

await self._start_idle_timer()

elif isinstance(frame, BotStartedSpeakingFrame):

await self._cancel_idle_timer() # Bot 又开始说了

elif isinstance(frame, UserStartedSpeakingFrame):

self._user_turn_in_progress = True

await self._cancel_idle_timer() # 用户开始说了

elif isinstance(frame, FunctionCallsStartedFrame):

self._function_calls_in_progress += len(frame.function_calls)

await self._cancel_idle_timer() # Function call 开始了

典型用途:用户闲置 10 秒后推送一个提示语(“Are you still there?")。

5.8 完整数据流时间线

一个典型的用户-bot 对话轮次:

时间 ─────────────────────────────────────────────────→

[音频输入] ░░░░░████████████████████░░░░░░░░░░░░░░░░░

↑ ↑

│ │

[VAD] STARTING→SPEAKING STOPPING→QUIET

│(200ms确认) │(200ms确认)

▼ ▼

[VAD Frame] VADUserStartedSpeaking VADUserStoppedSpeaking

│ │

[Start策略] │ │

VAD策略 ─────→ trigger_turn_started │

│ │

[Controller] _user_turn=True │

reset all start策略 │

│ │

[Processor] broadcast(UserStartedSpeaking) │

broadcast_interruption() │

│ │

[Stop策略] │ │

TurnAnalyzer │← append_audio(每帧) → analyze_end_of_turn()

│ │ turn_complete?

│ │ start timeout(stt_timeout - stop_secs)

│ │

[STT] InterimTranscription... TranscriptionFrame (finalized)

│

[Stop策略] _maybe_trigger_user_turn_stopped()

text有 && turn_complete → 触发!

│

[Controller] _user_turn=false

reset all stop策略

│

[Processor] broadcast(UserStoppedSpeakingFrame)

│

[LLM Aggregator] 收集完成,触发 LLM 调用

5.9 设计洞察

为什么是策略模式而不是单一算法?

不同场景需要完全不同的轮次检测:

- 普通对话 → VAD + ML 模型(默认)

- 电话 IVR → 超时策略(简单可靠)

- 多模态 → 外部策略(由视觉或其他信号控制)

- 文本输入 → 无需 VAD,直接由转录触发

策略模式让这些场景可以通过组合不同策略来实现,而不是修改核心逻辑。

Start 和 Stop 的不对称性

Start 策略极其简单(几行代码),Stop 策略极其复杂(200+ 行)。这反映了问题本身的不对称性:

- 开始说话:检测到声音就行,代价低(最多中断一下 bot)

- 结束说话:判断错误代价高(过早 → bot 抢话,过晚 → 延迟太高)

所以 Stop 策略需要综合 VAD、ML 模型、STT 超时、transcript finalization 等多个信号。

VAD stop_secs 补偿贯穿整个系统

stop_secs(VAD 确认静音的等待时间)在多处被用于时间补偿:

TurnAnalyzerUserTurnStopStrategy:timeout = stt_timeout - stop_secsSpeechTimeoutUserTurnStopStrategy:effective_stt_wait = stt_timeout - stop_secsUserBotLatencyObserver:user_stopped_time = frame.timestamp - frame.stop_secs

这是因为 VAD 确认静音时,那段静音时间已经过去了——STT 可能已经在处理了。

5.10 VAD 模型实现深度解析

5.10.1 Silero VAD — ONNX 模型推理

Source: src/pipecat/audio/vad/silero.py

Silero VAD 是 Pipecat 的默认 VAD 实现,使用预训练的 ONNX 模型进行语音活动检测。

模型架构:

# silero.py:34-127 — SileroOnnxModel

class SileroOnnxModel:

def __init__(self, path, force_onnx_cpu=True):

opts = onnxruntime.SessionOptions()

opts.inter_op_num_threads = 1 # 单线程推理

opts.intra_op_num_threads = 1

self.session = onnxruntime.InferenceSession(path, providers=["CPUExecutionProvider"])

self.reset_states()

self.sample_rates = [8000, 16000] # 只支持这两种采样率

def __call__(self, x, sr: int):

"""每次处理固定大小的帧"""

num_samples = 512 if sr == 16000 else 256 # 32ms @ 16kHz 或 32ms @ 8kHz

# 关键:模型维护内部状态(RNN 隐状态 + 上下文缓冲)

context_size = 64 if sr == 16000 else 32

x = np.concatenate((self._context, x), axis=1) # 拼接上下文

ort_inputs = {"input": x, "state": self._state, "sr": np.array(sr, dtype="int64")}

ort_outs = self.session.run(None, ort_inputs)

out, state = ort_outs

self._state = state # 更新 RNN 隐状态

self._context = x[..., -context_size:] # 保留上下文尾部

return out # 置信度值 [0, 1]

关键设计细节:

- 固定帧大小:16kHz 时每帧 512 采样点(32ms),8kHz 时 256 采样点。这决定了

VADAnalyzer的num_frames_required()返回值 - 有状态推理:模型内部维护 RNN 隐状态

_state(shape:[2, 1, 128])和上下文缓冲_context。每次推理都依赖前一次的状态,所以不能并发调用 - 周期性状态重置:每 5 秒重置一次模型状态,防止内存无限增长:

# silero.py:216-219

_MODEL_RESET_STATES_TIME = 5.0

curr_time = time.time()

if diff_time >= _MODEL_RESET_STATES_TIME:

self._model.reset_states()

数据流转换链:

原始音频 (PCM int16 bytes)

│

▼ np.frombuffer(buffer, np.int16)

int16 数组

│

▼ .astype(np.float32) / 32768.0

float32 数组 [-1.0, 1.0]

│

▼ model(audio_float32, sample_rate)

置信度 float [0.0, 1.0]

│

▼ VADAnalyzer._run_analyzer() 状态机判断

VADState (QUIET | STARTING | SPEAKING | STOPPING)

5.10.2 VADAnalyzer 缓冲机制

VADAnalyzer.analyze_audio() 不是每收到一帧音频就分析一次。它维护一个内部缓冲区,积累到足够的帧数后才调用模型:

# vad_analyzer.py:190-200

def _run_analyzer(self, buffer: bytes) -> VADState:

self._vad_buffer += buffer # 追加到内部缓冲

num_required_bytes = self._vad_frames_num_bytes # 512*2=1024 bytes @ 16kHz

if len(self._vad_buffer) < num_required_bytes:

return self._vad_state # 不够一帧,返回当前状态

# 可能积累了多帧(如果上游给了大 chunk),逐帧处理

while len(self._vad_buffer) >= num_required_bytes:

audio_frames = self._vad_buffer[:num_required_bytes]

self._vad_buffer = self._vad_buffer[num_required_bytes:]

confidence = self.voice_confidence(audio_frames) # 调用模型

volume = self._get_smoothed_volume(audio_frames)

# ... 状态机转换逻辑 ...

音量平滑过滤: 除了模型置信度,还使用指数平滑的音量作为额外信号:

# vad_analyzer.py:207

speaking = confidence >= self._params.confidence and volume >= self._params.min_volume

双条件确保:即使模型给出高置信度,如果音量太低(如风扇噪声恰好有语音特征),也不会误触发。

5.10.3 VADController 的帧生成时序

VADController 不直接生成帧——它触发 sync=True 的事件,由注册在事件上的处理器(UserTurnProcessor)来生成帧:

InputAudioRawFrame

│

▼

VADController._handle_audio()

│

▼

VADAnalyzer.analyze_audio() → VADState

│

├─ SPEAKING (从 QUIET/STARTING 变为) → _call_event_handler("on_speech_started")

│ ↓ (sync=True, 立即执行)

│ UserTurnProcessor 注册的 handler

│ ↓

│ broadcast_frame(VADUserStartedSpeakingFrame)

│ broadcast_frame(SpeechActivityFrame)

│

└─ QUIET (从 SPEAKING/STOPPING 变为) → _call_event_handler("on_speech_stopped")

↓ (sync=True, 立即执行)

UserTurnProcessor 注册的 handler

↓

broadcast_frame(VADUserStoppedSpeakingFrame)

为什么 sync=True 至关重要? 如果事件是异步的(默认),handler 会在独立的 Task 中执行。这意味着当下一个音频帧到达时,上一个帧的 VAD 事件可能还没来得及触发。对于需要精确时序的 turn detection 来说,这种延迟是不可接受的。

5.11 STT 转录流与 Finalization 机制

5.11.1 STT 服务基类架构

Source: src/pipecat/services/stt_service.py

STT 服务有三种基类,适用于不同的语音转文字模式:

AIService

└── STTService # 连续流式 STT(如 Deepgram WebSocket)

├── SegmentedSTTService # 分段式 STT(VAD 分段后批量处理)

└── WebsocketSTTService # WebSocket 连接管理 + STTService

| 基类 | 音频处理方式 | finalized 机制 | 典型服务 |

|---|---|---|---|

STTService | 连续流式,每个 AudioRawFrame 都送给 run_stt() | 需要服务端确认(request_finalize / confirm_finalize) | Deepgram, AssemblyAI, Soniox |

SegmentedSTTService | VAD 分段后批量处理,用户停止说话时才送音频 | 每个 TranscriptionFrame 自动 finalized=True | Whisper, 离线批量 STT |

WebsocketSTTService | 同 STTService,额外管理 WebSocket 连接生命周期和 keepalive | 同 STTService | Deepgram, Speechmatics |

5.11.2 音频处理流程

# stt_service.py:330-383 — process_frame()

async def process_frame(self, frame: Frame, direction: FrameDirection):

if isinstance(frame, StartFrame):

await self.push_frame(frame, direction)

await self._push_stt_metadata() # ★ 广播 STTMetadataFrame

elif isinstance(frame, AudioRawFrame):

await self.process_audio_frame(frame, direction) # 送给 run_stt()

if self._audio_passthrough:

await self.push_frame(frame, direction) # 透传音频给下游

elif isinstance(frame, VADUserStartedSpeakingFrame):

await self._handle_vad_user_started_speaking(frame)

await self.push_frame(frame, direction)

elif isinstance(frame, VADUserStoppedSpeakingFrame):

await self._handle_vad_user_stopped_speaking(frame)

await self.push_frame(frame, direction)

关键观察:audio_passthrough=True(默认)。 STT 服务处理完音频后仍然把 AudioRawFrame 推送给下游。这是因为 Turn Detection 模型(TurnAnalyzerUserTurnStopStrategy)也需要原始音频作为输入。如果 STT 吞掉了音频帧,turn detection 就无法工作。

5.11.3 TranscriptionFrame 与 Finalization

转录帧有两种类型:

# frames.py

@dataclass

class InterimTranscriptionFrame(TextFrame):

"""部分/中间转录结果,随着用户说话持续更新"""

text: str

user_id: str

timestamp: str

@dataclass

class TranscriptionFrame(TextFrame):

"""最终转录结果"""

user_id: str

timestamp: str

finalized: bool = False # ★ 核心字段

finalized 的语义: 当 finalized=True 时,表示 STT 服务确认这段语音的转录已经完成。Turn Stop 策略可以立即触发,而不需要等待 STT 超时。

Finalization 的两种路径:

路径 1:服务端确认(连续流式 STT)

# stt_service.py:158-181

def request_finalize(self):

"""标记已发送 finalize 请求"""

self._finalize_requested = True

def confirm_finalize(self):

"""服务端确认 finalize"""

if self._finalize_requested:

self._finalize_pending = True

self._finalize_requested = False

# 在 push_frame 中自动标记

async def push_frame(self, frame: Frame, direction=...):

if isinstance(frame, TranscriptionFrame):

if self._finalize_pending:

frame.finalized = True # ★ 自动标记

self._finalize_pending = False

例如 Deepgram:用户停止说话时,发送 finalize 命令;Deepgram 返回最终转录并在元数据中设置 from_finalize=True;STT 服务调用 confirm_finalize();下一个 TranscriptionFrame 被标记为 finalized。

路径 2:自动标记(分段式 STT)

# stt_service.py:597-609 — SegmentedSTTService.push_frame()

async def push_frame(self, frame, direction=...):

if isinstance(frame, TranscriptionFrame):

frame.finalized = True # ★ 分段 STT 的每个转录都是 finalized

await super().push_frame(frame, direction)

分段式 STT 在用户停止说话后才处理音频,所以每次返回的转录天然就是最终结果。

5.11.4 STTMetadataFrame — 延迟特征广播

# stt_service.py:414-420

async def _push_stt_metadata(self):

ttfs = self._ttfs_p99_latency

if ttfs is None:

ttfs = DEFAULT_TTFS_P99 # 1.0 秒(保守默认值)

await self.broadcast_frame(STTMetadataFrame, service_name=self.name, ttfs_p99_latency=ttfs)

在 StartFrame 时广播,告知下游处理器此 STT 服务的延迟特征。 Turn Stop 策略用这个值来计算超时:

# turn_analyzer_user_turn_stop_strategy.py:99

if isinstance(frame, STTMetadataFrame):

self._stt_timeout = frame.ttfs_p99_latency

各 STT 服务的实测 P99 TTFS 延迟:

| 服务 | TTFS P99 (秒) | 特点 |

|---|---|---|

| Deepgram | 0.35 | 最快,支持 finalize |

| Soniox | 0.35 | 与 Deepgram 并列最快 |

| AssemblyAI | 0.42 | 快速 |

| ElevenLabs Realtime | 0.41 | 实时模式 |

| Speechmatics | 0.74 | 中等 |

| Cartesia | 0.81 | 中等 |

| Sarvam | 1.17 | 较慢 |

| Gladia | 1.49 | 较慢 |

| 1.57 | 较慢 | |

| Azure | 1.80 | 慢 |

| AWS Transcribe | 1.90 | 慢 |

| OpenAI | 2.01 | 慢 |

| SambaNova | 2.20 | 最慢 |

为什么这些数字如此重要? TTFS P99 直接影响用户体验中的 “bot 响应延迟”。以 Deepgram (0.35s) vs AWS Transcribe (1.90s) 为例:

用户停止说话后...

Deepgram: 0.35s 后收到最终转录 → 触发 LLM → 总延迟 ≈ 0.35 + LLM时间

AWS: 1.90s 后收到最终转录 → 触发 LLM → 总延迟 ≈ 1.90 + LLM时间

这 1.55 秒的差距在对话中非常明显。

5.11.5 STT TTFB 测量机制

STT 服务还测量自身的"首字节时间”(TTFB),但 STT 的 TTFB 定义不同于传统 HTTP:

# stt_service.py:99-104 — 注释说明

# STT "TTFB" differs from traditional TTFB (which measures from a discrete

# request to first response byte). Since STT receives continuous audio, we measure

# from when the user stops speaking to when the final transcript arrives—capturing

# the latency that matters for voice AI applications.

测量流程:

VADUserStoppedSpeaking

│

├── speech_end_time = timestamp - stop_secs # 真实停止时间(补偿 VAD 延迟)

├── start_ttfb_metrics(start_time=speech_end_time)

└── 启动 _ttfb_timeout_handler (2.0s 超时)

│

├── 如果收到 finalized TranscriptionFrame → 立即 stop_ttfb_metrics()

└── 如果超时 → 用 _last_transcript_time 作为结束时间 stop_ttfb_metrics()

5.12 Turn Detection 模型实现深度解析

5.12.1 BaseSmartTurn — 批量分析器基础

Source: src/pipecat/audio/turn/smart_turn/base_smart_turn.py

BaseSmartTurn 是所有基于 ML 的 Smart Turn 分析器的基类,实现了音频缓冲、语音段提取、静音超时三大核心功能。

音频缓冲机制:

# base_smart_turn.py:101-147

def append_audio(self, buffer: bytes, is_speech: bool) -> EndOfTurnState: